定义及设计

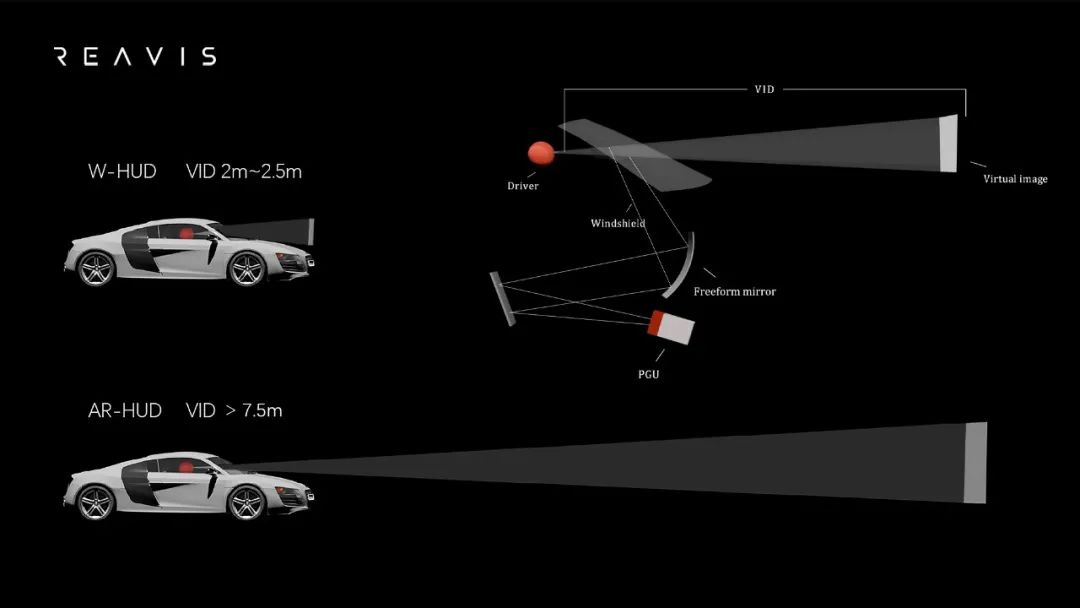

VID的全称是Virtual Image Distance,即虚像距离,它指投影虚像到人眼瞳孔之间的距离,如图(1)所示。对于HUD而言,W-HUD的VID通常设置为2m~3m(米),AR-HUD的VID为7.5m~10m,更远的可以达到10m~ 15m[1]。

在进行HUD光学设计时,会根据实际需求明确FOV和VID的设计值,然后基于整车预留的空间进行初步的光学镜片摆放。我们在自由曲面原理(上)有介绍,HUD中常用的光学架构为单自由曲面镜加平面镜或双自由曲面,无论是单曲还是双曲,在FOV相同的情况下,VID越大,对应的系统光学距离(两块镜片之间的距离+镜片与PGU之间的距离)越长,最终的HUD的体积也越大[2],这也是AR-HUD会比W-HUD体积大的一个直接原因。

但在实际情况下,通常车体预留的空间有限,要求HUD的体积不能太大,此时就无法通过增加系统光学间距的方式,来匹配大VID的设计。另一种方法是,在固定光学间距的情况下,通过增加自由曲面放大倍率(可简单理解为自由曲面曲率的变大,但实际设计会更复杂)的方式来实现更大的VID(如图(2)(B))。但该方法也有弊端,放大倍率的增加,会使整个系统的其他光学参数更难控制,同时对于系统公差的要求也更高。除了这两种传统的方法外,双曲的使用以及新型光学系统的使用,也有助于在更小的HUD体积下实现更大的VID。

VID的取舍

可以看到,W-HUD和AR-HUD对于VID的设计值是不一样的。W-HUD通常进行持续显示,即常态地显示驾驶员需要时刻关注的重要信息,如车速、限速、报警提醒等。因此,W-HUD的内容通常会要求下视角(LDA)更大,且显示位置在引擎盖边缘上方(该距离下的VID通常为2m~2.5m),从而实现:(1) W-HUD的内容处于视野下方,避开正前方的场景;(2) 当驾驶员正常驾驶时,眼睛属于放松的状态,聚焦距离较远,处于近距离的W-HUD会自然地虚化。结合这两点,W-HUD的显示内容不会干扰驾驶。

AR-HUD通常进行间断显示,即只有当特定的场景出现的情况下,才会进行短时间的AR辅助驾驶内容显示,如导航中的变道、转向,前车预警,车道线识别等[3]。当这些特定场景未出现时,AR显示区域是不显示任何内容的。这样能实现常态下不干扰驾驶员的正常驾驶,但在需要时能进行短时的、间断的AR辅助内容,帮助驾驶员获得重要的信息,减少事故的发生[3]。在这样的情况下,AR-HUD通常需要更远的、甚至是能连续变化的VID,具体考量如下:

(1)视觉疲劳

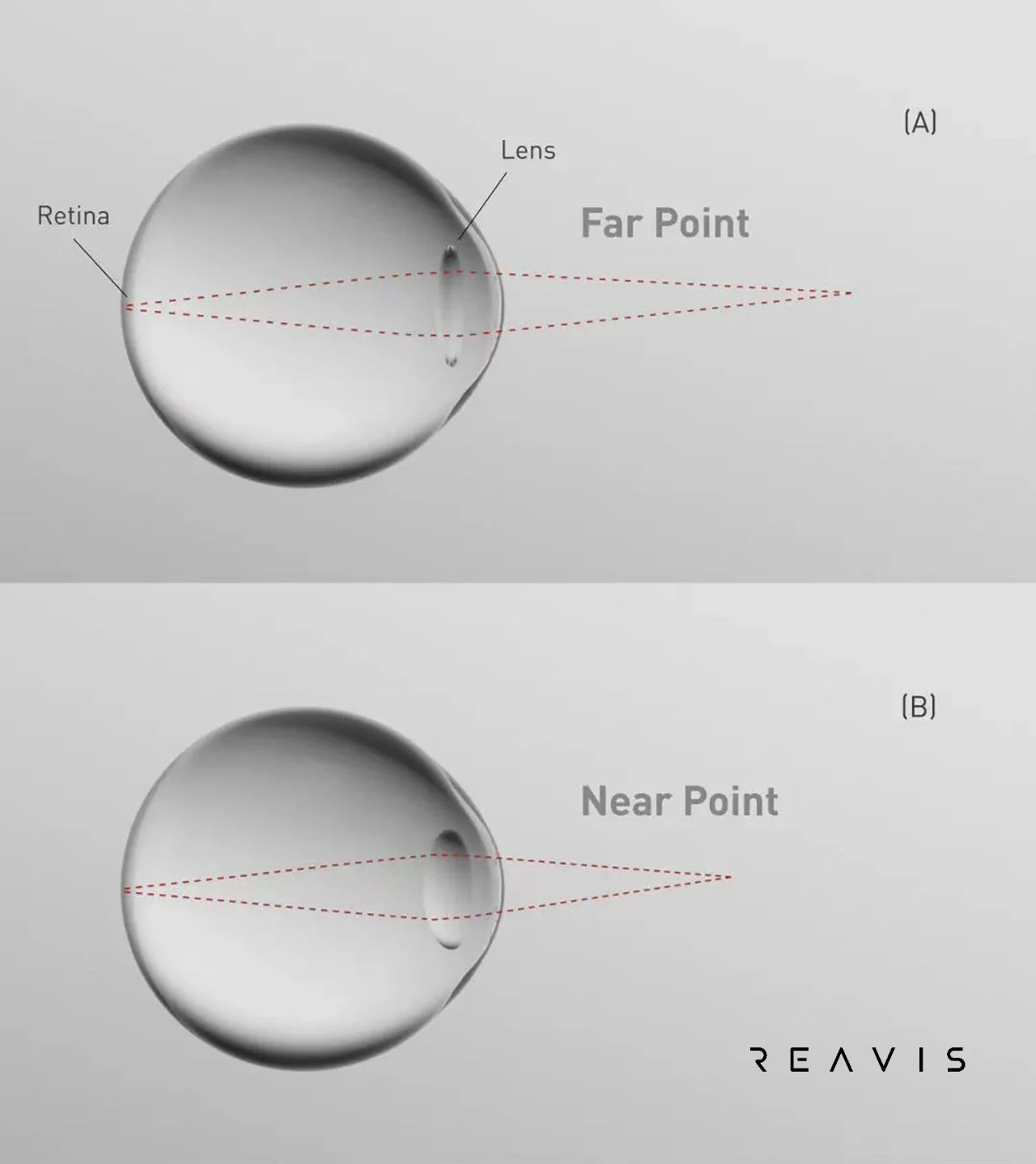

我们已经提到,AR-HUD的间断显示特点是服务于驾驶员正常驾驶的过程中,此时驾驶员的双眼聚焦于较远的距离。在3D深度视觉原理(上)里,我们介绍过晶状体聚焦和辐辏。当观察近距离物体时,我们的睫状肌需要收缩,使晶状体凸度更大,从而使眼睛的焦距更短(图(3))[4]。辐辏则是人眼向内旋转以聚焦于目标对象的行为,在我们看更近的物体时,眼睛需要更大程度地向内旋转,这也会造成视觉上的疲劳感[5]。

因此,如果AR-HUD的VID较近的话,会使驾驶员在远距离的聚焦(正常驾驶状态)与的AR内容(较近VID)之间来回转换,频繁调动眼部肌肉,在实际物体和虚拟图像之间切换聚焦,长时间下来便会产生视觉疲劳[6]。研究表明,当观察为6m及以下时,睫状肌需要用力收缩以保证双眼的聚焦在物体上,疲劳感有所增加[6],通常AR-HUD的VID会做到7.5米及以上。

(2)虚像贴合

顾名思义,AR-HUD最重要的功能就是AR(增强现实),也就是让HUD的虚拟图像与现实世界场景进行结合与互动[3]。AR的功能依赖于对实景图像进行分析,结合人眼的位置及角度,计算出虚拟图像的投影位置[7]。但是,当人眼改变位置时,虚像与现实世界适配程度会发生改变,视差指的就是感知到虚像和现实的不重合[6]。

如图(4)所示,在正常驾驶时(聚焦远处,人眼处于放松状态),VID分别为2m和10m,而红色、蓝色的矩形标识为HUD投影的虚像与现实场景中的行人、汽车实现了完美贴合。

然而,当驾驶员将头稍微向左移动,虚像的位置也发生了改变,从而导致虚像和现实世界的错位。我们可以看到,在VID为2m的情况下,红色和蓝色矩形完全偏离了对于行人和汽车的标识(图(5)(A));而10m的VID下,错位要小得多,并且不那么明显(图(5)(B))。由此可见,在短距离VID中,即使驾驶员头部发生的只是轻微的移动,强烈的视差也会使得虚像和现实世界发生大幅度错位[6]。

为了实现图形与现实世界的深度融合、将驾驶信息的投射虚像与现实事物更完好地叠加,减少HUD行车的疲惫和眩晕感[3],AR-HUD的AR部分通常需要更大的VID来实现,现阶段AR-HUD常见的VID是7.5m~10m,再远一些有10m~15m[1]。

但对于AR-HUD来说,VID并不是越大越好,我们将在下一期为大家详细介绍。

#参考来源:

[1]Firth, M. (2019). "Introduction to automotive augmented reality head-up displays using TI DLP® technology". Technical document, May.

[2]Howells,P.J., Brown,R. (2007). "Challenges with displaying enhanced and synthetic vision video on a head-up display". In Enhanced and Synthetic Vision 2007 (Vol. 6559, pp. 155-164). SPIE.

[3]Merenda, C., Kim, H., Tanous, K., Gabbard, J. L., Feichtl, B., Misu, T., & Suga, C. (2018). Augmented reality interface design approaches for goal-directed and stimulus-driven driving tasks. IEEE transactions on visualization and computer graphics, 24(11), 2875-2885.

[4]Duane, Alexander. (1922). "Studies in Monocular and Binocular Accommodation with their Clinical Applications". American Journal of Ophthalmology. 5 (11): 865–877.

[5]Cassin, B. (1990). "Dictionary of Eye Terminology. Solomon S. Gainesville, Fl: Triad Publishing Company". ISBN 978-0-937404-68-3.

[6]TEXAS INSTRUMENTS. (2022). "The Importance of a Longer VID for AR HUDs". Technical White Paper

[7] Wu QH. (2019). "The Application and Development Trend of Augmented Reality (AR) Technology". Communications World.